天空から注ぐ科学の目!リモートセンシングのスゴい最新技術

昨今、エンタメシーンでの動画撮影や建築現場の状況把握に、ドローンによる空撮が用いられることが増えている。しかし「空から地上の様子を撮影する手段」はドローンだけではないし、「撮影できる画像の種類」も通常のカラー写真だけではない。

技術や宇宙ビジネスの発展により、宇宙空間に打ち上げられた人工衛星を活用したり、人間の目には見えない波長の光を使った撮影を行ったりすることで、様々な情報を取得し、ビジネスや研究に活用できるようになっているのだ。

今回は、そんなはるか上空からの地上観測技術「リモートセンシング」の基本と最新の技術状況について、ぎゅっとコンパクトにまとめてお伝えしよう。

リモートセンシングとは?

リモートセンシングとは、広義には「離れた場所から、非接触で種々の指標を測定する技術」を意味するが、多くの場合はもう少し狭義に「人工衛星・航空機・ドローンなどを利用して地表面を観測する技術」という意味合いで使われている。

人工衛星などに搭載されたカメラやセンサによって、地上の車や海上の船舶、災害の発生状況、地表温度、降雨状況、植物の成長度合い、建物や橋梁などの構造物の劣化など、様々な事象を離れた場所から捉え、必要なアクションに繋げることを可能にする技術だ。

世界で最初にリモートセンシングが行われたのは今から150年以上前の1858年、フランス人のガスパード・トゥルナションが気球からパリを空撮したのが始まりとされている。その後、プラットフォームは航空機、人工衛星、ドローンと選択肢の幅が広がり、さらにカメラ・センサも解像度の改善や可視光以外の波長の活用などの進化を遂げた。

とくに可視光以外の波長の光を用いることは、「人間の目では見えない情報」の取得につながった。例えば、植物は近赤外線という波長の光を強く反射することが知られていて、これは緑色のペンキにはない性質だ。これを利用することで、空から撮影した写真から「作物が植えられている畑」と「緑色の屋根」を簡単に区別することが可能になった。

センシングに用いる光の波長以外にも、リモートセンシングは様々な切り口での進化を遂げている。現時点で実現されているリモートセンシング技術にはどんなものがあるのか、紹介していこう。

不可視の情報を得るマルチスペクトル/ハイパースペクトルカメラ

私たちが普段目にするカラー写真は、様々な波長(色)をまとめて撮像したものだ。しかし、同じ黄色に見えているものでも、「黄色の光を反射する成分が多い」のか、「黄色の光以外を反射する成分が少ない」のか(すなわち相対的に黄色の光の反射が強いのか)によって、撮影対象に対する科学的な理解は変わってくる。

例えば、イチョウは秋になると葉が黄色くなるが、これは黄色い成分が増えたわけではなく、緑色の成分である葉緑体の分解により、相対的に黄色い成分が目立つようになった結果なのだ。

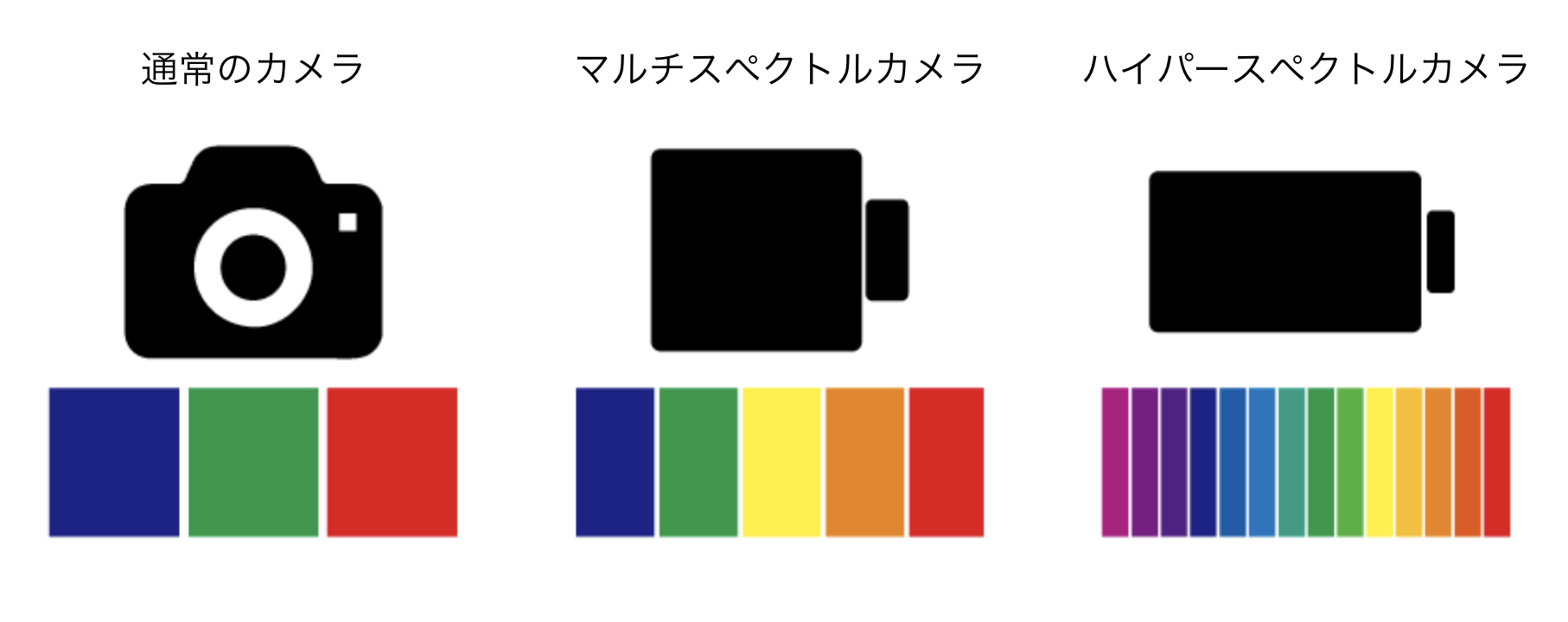

このように、各波長ごとの反射特性を調べるために用いられているのが「マルチスペクトルカメラ」や「ハイパースペクトルカメラ」だ。

両者の違いは、独立して観測できる光の波長の幅(バンド幅)の細かさだ。マルチスペクトルカメラでは10バンド程度、ハイパースペクトルカメラでは100〜200バンドもの異なる光の波長でのデータを取得することができる。

当然、ハイパースペクトルカメラの方が様々な情報が得られるが、まだまだ搭載されているプラットフォームが少なく、価格も高価であるため、利用できるシーンは限られている。一方、マルチスペクトルカメラであれば、一部の人工衛星のデータは無料で利用することが可能だ。

マルチスペクトルとハイパースペクトルカメラは、農作物の生育状況の把握(衛星)(ドローン)、鉱物資源の探索(衛星)などに利用されている。

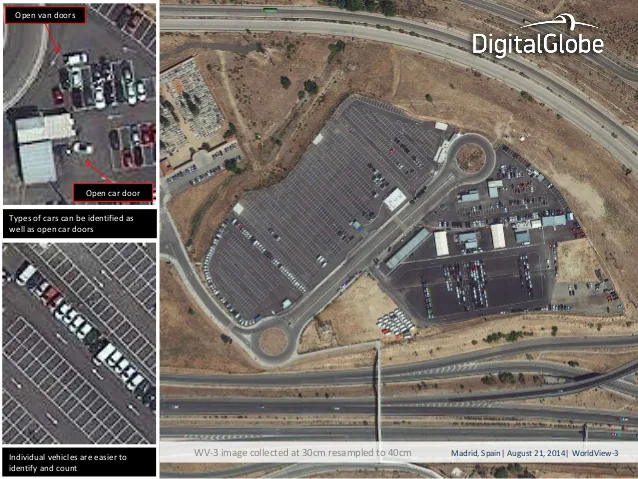

宇宙から車の種類まで特定する超高解像度衛星

1990年代以前に打ち上げられた人工衛星に搭載されているセンサの空間分解能(独立した2点を見分ける能力)は数メートル〜数十メートル程度だったが、技術革新によるセンサの進化に伴い、今や1メートル未満の空間分解能を持つセンサを搭載した衛星も登場している。

これくらいの解像度になると、駐車場に止まっている車の数のみならず、そのタイプまで特定できる。これを応用して、スーパーマーケットの売上予測などが行われている。

毎日定時の定点観測ができるコンカテネーション衛星

人工衛星を利用したリモートセンシングを行う場合、数日〜数週間に一回しか同じ地点を撮影することができないという問題が発生する。人工衛星は地球上の決まった軌道上を周回しているが、この周回にかかる日数(回帰日数)がそのままその衛星で実行可能な撮影間隔となるからだ。

一般的には、より詳細な画像を撮影できる人工衛星ほど、回帰日数が長くなる。高解像度カメラを用いる場合は一度に撮影できる範囲が限られてしまい、全地表面を網羅しようとした場合に少しずつ軌道をずらしながら周回する必要があるためだ。

近年はこうした問題を解決するために、同じ周回軌道上に多数の衛星を投入する「衛星コンステレーション」という運用方式が注目されている。これにより、ある地点の上空を複数の衛星が変わるがわる通過することになるため、2台体制であれば1/2、4台体制であれば1/4と、見かけの回帰日数を大幅に短縮することができる。

例えば、欧州主体で運用されていてデータの無償利用も可能なSentinel 2衛星は、現在3台体制(2022年より4台体制となる予定)で運用されており、回帰日数は3-5日となっている。また米国のスタートアップであるPlanet社は、なんと100機以上の衛星によるコンステレーション運用体制を確立している。

繊細な画像が得られるドローン

ドローンを利用したリモートセンシングの最大の利点は、画像解像度の高さだ。宇宙から撮影する人工衛星の場合は1ピクセルあたり数m〜数十cm、航空機の場合は1 m〜数 cmですが、ドローンの場合は1 cm未満という高い解像度となる。1 cm未満の解像度となると、構造物表面の小さなひび割れや、農作物の花や果実の一つ一つを捉えることも可能になってくる。

また人工衛星は雲がかかっている とほとんどデータが取得できなくなるのに対して、ドローンはよほどの悪天候や風の強い日でなければ撮影が可能である。ただし、常に現地まで赴いてドローンを飛ばすためのオペレーションコストがかかることは念頭に置いておく必要がある。

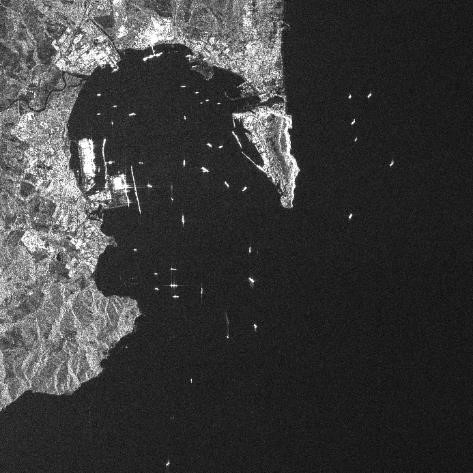

雲がかかっていても地表面を観測できる合成開口レーダー

太陽光を光源としてその反射光を撮像する通常の撮影原理と異なり、自ら電波を地上に向けて照射し、その反射を利用して地表面を観測するのが「合成開口レーダー」だ。この原理により、昼夜ともに天候に関わらず、衛星軌道から高い解像度の情報を取得できる。

また、異なる日時に撮影された画像を比較する解析により、目視では判別できないような地盤や構造物の小さな変異や歪みを検知することができる。こうした特性を活かし、合成開口レーダーは建物・橋梁・インフラ設備の老朽化モニタリングや斜面崩落などの自然災害発生状況の把握などに活用されている。

ということで、今回の科学コラムでは、上空から地上を観測するリモートセンシング技術の概要と応用事例を、簡単な原理の説明と共に紹介した。

地表面を「撮影する」と一口に言っても、我々が普段使わない様々なアプローチが存在する。そして、種々の撮影技術の発展、ドローン技術の発展、宇宙空間を活用したビジネスの開拓などにより、リモートセンシングを利用するハードルはどんどん下がってきている。今後ますます、「空から地表面を見る」という観点が、さまざまな研究やビジネスを前進させるヒントになるだろう。

この記事を書いたのは